每日經濟新聞 2023-02-11 16:33:52

◎對于利用ChatGPT寫作論文的情況,有較大可能會出現侵權問題。

每經記者 文巧 蔡鼎 鄭雨航 每經編輯 高涵

ChatGPT大熱,不少人已經用它來寫作業、寫論文、寫演講稿……ChatGPT快速高效的內容創作能力也讓不少人驚呼,內容創作是不是要被AI取代了?

然而,樂此不疲地使用這項新技術生成內容的同時,我們應該思考一個問題:ChatGPT生成的內容是否有著作權?其“創作”的版權又該歸誰? 這項技術的使用真的安全可靠嗎?

對于上述問題,2月11日,《每日經濟新聞》記者對話奮迅律師事務所(貝克·麥堅時聯營律所)合伙人周整、泰和泰律師事務所首席合伙人程守太、安杰世澤律師事務所合伙人于雯竹以及上海明倫律師事務所律師王智斌,進行了探討。

在某銷售ChatGPT賬號的淘寶商家的用戶評價中,《每日經濟新聞》記者發現,有購買者的訴求是使用ChatGPT寫論文。2月9日,每經刊發的報道也顯示,國內高校已經有學生開始使用ChatGPT寫論文。

今年1月初,美國北密歇根大學的學生利用ChatGPT寫作論文的事件還歷歷在目,ChatGPT給美國教育體系帶來的沖擊顯而易見:許多大學正在對課堂進行大規模的調整,紐約和西雅圖等學區已禁止在其設備和網絡中使用ChatGPT。

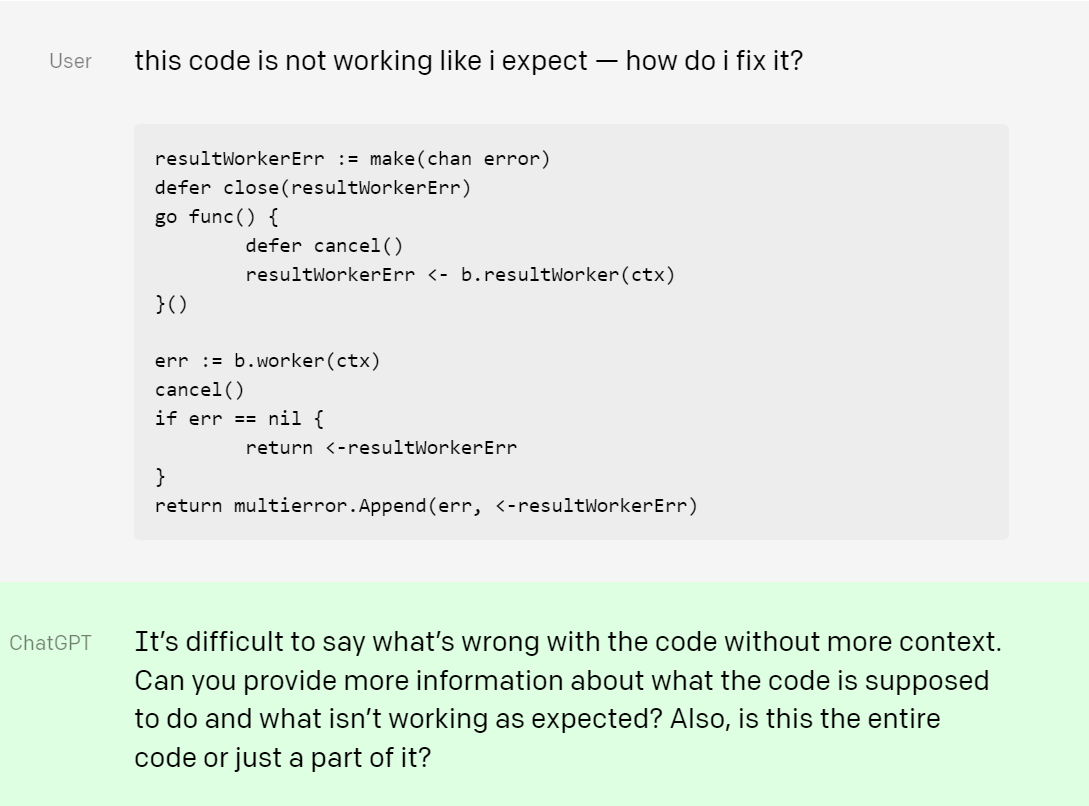

用ChatGPT寫代碼 圖片來源:OpenAI

隨著越來越多的人使用該技術來生成內容,一個問題是,ChatGPT生成的內容會產生著作權嗎?

安杰世澤律師事務所合伙人于雯竹向每經記者表示,在中國,根據相關判決,一個作品享有著作權的前提之一是由自然人創作。“因此,如果ChatGPT生成內容的創作過程中表現出了自然人作者(即ChatGPT的用戶)的個性化判斷、取舍、風格等寫作安排,且ChatGPT生成內容滿足了著作權法的其他要求(比如獨創性),則ChatGPT生成的該內容可認為是著作權法意義上的作品,享有著作權。”

不過,奮迅律師事務所合伙人周整則告訴記者,關于AI創作的作品是否具有獨創性,目前尚無定論。他給出了兩個案例,“我國司法實踐中存在不同的觀點。在騰訊訴盈訊案中,騰訊利用智能寫作Dreamwriter創作的文章被盈訊發布在互聯網上,深圳南山區法院認可了該文章著作權人為騰訊。”

“但在菲林律所訴百度公司案中,菲林利用某家智能可視化軟件自動生成報告,而北京互聯網法院拒絕承認菲林對該報告享有著作權,并稱在自動生成報告中簡單的數據選擇和圖像選擇并不足以具有獨創性,”他說道。

另一個問題是,ChatGPT生成的論文若有著作權,應當屬于誰?對于這一點,律師間也有一些不同的看法。

周整認為,可以參考騰訊案中的觀點,即AI軟件生產的作品的著作權應歸屬于該軟件的所有者。他表示,“因為ChatGPT生成內容的原理是參考現有互聯網內容并按照用戶指令生成解答,而ChatGPT這個軟件本身就是作品,具有著作權,我們可以認為其形成解答內容的過程是通過內部的無數模板完成的,這些模板本身也可能構成具有獨創性的表達,受到著作權保護。”

在于雯竹看來,根據OpenAI的使用條款中規定,在用戶遵守相關條款和法律法規的前提下,OpenAI 將其對ChatGPT 所輸出內容的所有權利、所有權和利益轉讓給用戶,這其中就包括了著作權。“當然,前提是ChatGPT生成的內容被認定為‘作品’,享有著作權,”她補充說道。

泰和泰律師事務所首席合伙人程守太告訴記者,ChatGPT屬于人工智能,其并非屬于我國著作權法意義上的作者,其生成的內容是否享有著作權、由誰享有著作權還存在爭議。

“一般來說,AI生成的內容具有獨創性并能以一定形式表現的即享有著作權,”程守太說道,“但根據ChatGPT的服務條款可知,只有該聊天軟件獨有的‘輸出內容’才發生著作權的轉讓,該規定在一定程度上保護了ChatGPT,但對于用戶來說增加了極大的不確定性。在后續傳播過程中,也會出現權利鏈條不清晰,權利人不清晰的問題。”

不過,對于利用ChatGPT寫作論文的情況,前述三位律師都認為,有較大可能會出現侵權問題。

“因為AI生成內容的基礎是海量分析互聯網上的現有信息和內容,其中當然包括受到著作權法保護的作品。基于他人作品,并通過模仿他人表達方式生成的結果,具有侵權風險的可能性較大。但隨著人工智能技術的發展,可能以后會繞開跟現有作品同樣的表達,從而規避侵害著作權的風險,”周整告訴《每日經濟新聞》記者。

ChatGPT的強大令許多人嘖嘖稱奇,關于其生成內容的安全性也開始引發思考。

第一是內容準確性問題。“ChatGPT生成內容的準確性無法保障。用戶隨手將網上看到的內容、觀點上傳到平臺,ChatGPT在用戶海量信息提取的過程中自主學習進化,此種數據來源不夠真實準確,”程守太告訴記者,“ChatGP也存在虛假信息回復問題,此種虛假回復應用在商業中會造成嚴重后果,甚至有法律風險。”

鑒于此,ChatGPT極容易被虛假信息誤導。據《紐約時報》2月8日報道,研究人員測試了ChatGPT在被問及充滿陰謀論和虛假敘述的問題后會寫些什么,結果非常令人不安。NewsGuard的聯合首席執行官Gordon Crovitz表示:“該工具能夠以超乎想象的規模生成虛假信息,而且頻率很高,它可能將成為互聯網有史以來最強大的錯誤信息傳播工具。”

第二是容易被不法者利用的問題。上海明倫律師事務所律師王智斌告訴每經記者,“問題的另一面是,使用者失去了自行查閱不同搜索結果并自行判斷的機會。從這個角度而言,ChatGPT更容易實現信息和答案的壟斷,也更容易成為輿情的操縱工具,”他說道。

據《紐約時報》,提供網絡威脅情報的組織Check Point Research發現,網絡犯罪分子已經在嘗試使用ChatGPT創建惡意軟件。該組織工程主管Mark Ostrowski表示,雖然黑客攻擊通常需要高水平的編程知識,但ChatGPT為新手程序員提供了幫助。

第三還可能存在數據安全的問題。程守太表示,“ChatGPT將網絡交互獲取的數據轉化為自己的知識圖譜或者存入知識庫,并上傳至相應運營公司數據平臺。其數據獲取途徑和獲取方式是否合法合規,數據的合理使用范圍、使用邊界問題、惡意利用問題,還需結合不同地區法律具體分析。”

同時,他認為,“用戶和ChatGPT交互的過程中,ChatGPT獲取大量用戶或者業務相關數據,若用戶在聊天時輸入了涉密信息,ChatGpt會識別信息并存在后臺,可能會導致侵犯個人信息,泄露個人隱私、商業秘密以及國家機密。”

第四需要注意價值導向的問題。在程守太看來,ChatGPT生產的內容是基于全網的數據和算法分析處理所得到的,與我國主流媒體的話語體系存在一些不兼容之處,尤其是互聯網企業、媒體使用時更需要考慮背后價值導向。

如需轉載請與《每日經濟新聞》報社聯系。

未經《每日經濟新聞》報社授權,嚴禁轉載或鏡像,違者必究。

讀者熱線:4008890008

特別提醒:如果我們使用了您的圖片,請作者與本站聯系索取稿酬。如您不希望作品出現在本站,可聯系我們要求撤下您的作品。

歡迎關注每日經濟新聞APP