每日經濟新聞 2023-09-07 22:37:13

每經編輯 蒙錦濤

9月7日,在2023騰訊全球數(shù)字生態(tài)大會上,騰訊混元大語言模型正式亮相,并宣布通過騰訊云對外開放。這是騰訊首次披露的通用大語言模型,具備強大的中文創(chuàng)作能力,復雜語境下的邏輯推理能力,以及可靠的任務執(zhí)行能力。

此前的大半年,國內云廠商跟隨ChatGPT,掀起“百模大戰(zhàn)”。一時間,國內生成式大語言模型多得讓人眼花繚亂。騰訊在市場激流勇進之后再“秀肌肉”,也映射了“混元”這個取自典籍的名字中“元氣生于混沌之中”的含義,它撥清迷霧,迎接新天地。

騰訊為什么此前不著急發(fā)通用大模型?在蟄伏的日子里,騰訊做了什么?騰訊混元大模型值得期待嗎?

“不急于把半成品拿出來展示”

在“百模大戰(zhàn)”經歷喧囂,逐漸降噪之時,騰訊不緊不慢地揭開自己大語言模型的神秘面紗,這體現(xiàn)了騰訊一如既往的風格——不爭一時熱度、用產品實力說話。

在今年5月騰訊2023年股東大會上,騰訊董事會主席兼首席執(zhí)行官馬化騰就如此評價大模型:“我們最開始以為這是互聯(lián)網十年不遇的機會,但是越想越覺得這是幾百年不遇的、類似發(fā)明電的工業(yè)革命一樣的機遇。互聯(lián)網企業(yè)都有很多的積累,都在做,我們也一樣在埋頭研發(fā),但是并不急于早早做完,把半成品拿出來展示。”

馬化騰認為,對于工業(yè)革命來講,早一個月把電燈泡拿出來在長的時間跨度上來看是不那么重要的。大模型之于互聯(lián)網技術革命,就如電燈之于工業(yè)革命。騰訊在乎的是這個“電燈”的實用性和耐用性,而不是死盯著早一步投入市場激起的那簇虛無的水花。

“關鍵還是要把底層的算法、算力和數(shù)據扎扎實實做好,而且更關鍵的是場景落地。”馬化騰說道。

在市場看不見的日子里,騰訊已經在大模型底層能力上埋頭鉆研多年。從2021年開始,騰訊先后推出千億和萬億參數(shù)的NLP稀疏大模型,打破CLUE三大榜單紀錄,實現(xiàn)在中文理解能力上的新突破。

在去年年末ChatGPT掀起大模型浪潮后,騰訊的大模型路線也穩(wěn)扎穩(wěn)打,利用自身多元且豐富的產品、數(shù)據、場景的優(yōu)勢,迭代了多個版本。騰訊的大模型在豐富的內部場景和應用上進行了反復錘煉,更清楚一個深入業(yè)務的大模型應該如何設計和研發(fā)。

騰訊集團副總裁蔣杰

騰訊集團副總裁蔣杰

相比于國內外已發(fā)布的大語言產品主要是通過聊天場景進行測試和訓練,騰訊選擇了用自家產品來測試。在騰訊集團副總裁蔣杰看來,測試大語言模型的途徑有很多。“一種是通過Chat來驗證,這會有比較好的體感。而騰訊有20多年的發(fā)展歷史,有海量的用戶和TO C的應用場景、TO B的驗證體系,用它們來測試或許會有更好的效果。”蔣杰表示。

就這樣,騰訊強大的產品矩陣,成為了混元大模型語料訓練的“養(yǎng)料”,也是場景應用的“磨刀石”。至今,騰訊混元大模型擁有超千億參數(shù)規(guī)模,預訓練語料超2萬億tokens。

目前,混元大模型已經接入騰訊50多個業(yè)務并取得初步效果,包括騰訊云、騰訊廣告、騰訊游戲、騰訊金融科技、騰訊會議、騰訊文檔、微信搜一搜、QQ瀏覽器等業(yè)務和產品。這其中既包括了C端應用,也包括了B端場景,其應用和測試的體量足以比擬甚至超越國內一些先發(fā)的其他大模型。

在騰訊全球數(shù)字生態(tài)大會上,騰訊正式宣布,混元大模型將作為騰訊云MaaS服務的底座,客戶不僅可以直接通過API調用混元,也可以將混元作為基底模型,為不同產業(yè)場景構建專屬應用。

自研的底氣

慢即是快,這是騰訊長期遵循的產品哲學。少了倉促的趕場,多了扎實的自研技術和創(chuàng)新優(yōu)勢。

全鏈路自研是騰訊混元大模型的亮點。據蔣杰介紹,騰訊混元大模型從第一個token開始從零訓練,掌握了從模型算法到機器學習框架,再到AI基礎設施的全鏈路自研技術。這其中包括大規(guī)模、高質量、多樣化的語料庫、創(chuàng)新的大模型算法和訓練方法、自研Angel機器學習框架、強大的算力基礎設施等。

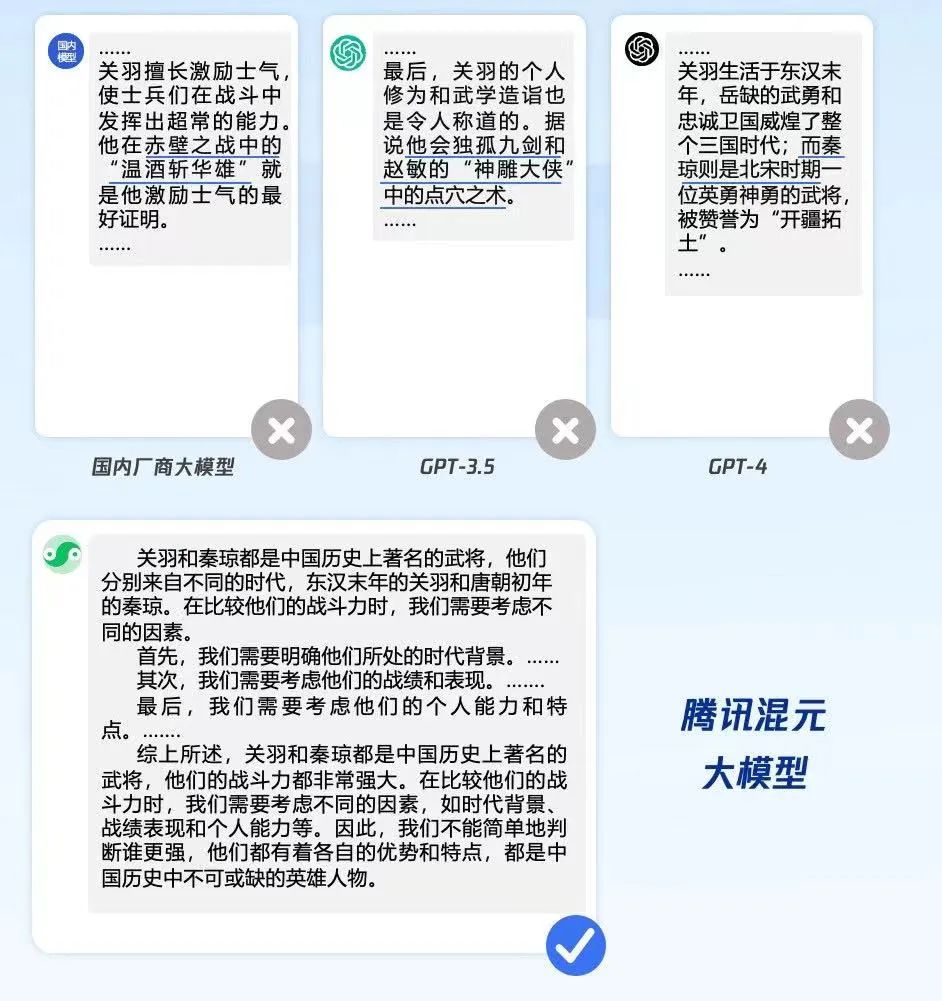

全鏈路自研帶來的效果,是顯而易見的。舉個例子,目前生成式AI在實際場景的應用比較受限,大部分停留在高容錯、任務簡單的休閑場景,例如詩詞生成。用戶在初嘗大模型時,往往會因其炫技式的作詩或者回答腦筋急轉彎而感到驚艷,然而,對于容錯率更低或任務更復雜的工作、專業(yè)以及嚴肅場景,如客服助手、醫(yī)療診斷、調研統(tǒng)計等領域,往往容易出現(xiàn)張冠李戴、胡言亂語的問題(即大模型“幻覺”),導致用戶對準確性和可靠性的呼聲極高。

可以說,“幻覺”扼住了大模型大規(guī)模應用的“咽喉”,讓企業(yè)和個人面臨嚴肅的需求時,不敢放心使用。對此,業(yè)界往往通過知識圖譜或者搜索外掛的方式試圖解決,但效果并不理想。而騰訊混元大模型給出的方案是——不依賴外掛,在預訓練階段通過“探真”算法進行事實修正,讓混元大模型的幻覺相比主流開源大模型降低了30%至50%。

不僅是降低幻覺,騰訊混元大模型還通過強化學習的方法,讓模型學會識別陷阱問題;通過位置編碼優(yōu)化,提高了超長文的處理效果和性能;提出思維鏈的新策略,讓大模型能夠像人一樣結合實際的應用場景進行推理和決策。它還能進行文學創(chuàng)作、文本摘要、角色扮演等內容創(chuàng)作,做到充分理解用戶意圖,并高效、準確地給出有時效性的答復。

此外,騰訊還自研了機器學習框架Angel,使訓練速度相比業(yè)界主流框架提升1倍,推理速度較業(yè)界主流框架提升1.3倍。

放眼市場,有眾多的開源大模型可以提供給廠商進行疊加和使用。相反,全鏈路自研就顯得并不取巧。那么,騰訊為何堅持做自研?蔣杰有自己的答案:“首先,如果企業(yè)不從頭開始做自研的話,就缺乏對這個技術的完全掌握;第二,騰訊大模型的自研,能夠加速后續(xù)的迭代,加快與其他業(yè)務的深度結合和綁定。對于騰訊那么多海量高并發(fā)的業(yè)務來說,開源架構無法應對沖擊,對騰訊來說是并不合適的。所以我們一定要走出一條基于自主體系的研發(fā)道路。”

在大模型扎堆的當下,全鏈路自研給了騰訊底氣。在中國信通院《大規(guī)模預訓練模型技術和應用的評估方法》的標準符合性測試中,混元大模型共測評66個能力項,在“模型開發(fā)”和“模型能力”兩個重要領域的綜合評價均獲得了當前的最高分。在主流的評測集MMLU、CEval和AGI-eval上,混元大模型均有優(yōu)異的表現(xiàn),特別是在中文的理科、高考題和數(shù)學等子項上表現(xiàn)突出。

業(yè)務的倍增器

“我們研發(fā)大模型的目標不是在評測上獲得高分,而是將技術應用到實際場景中。騰訊將全面擁抱大模型。”蔣杰說道。這也反映了騰訊從實踐中來,到實踐中去的產品初心。

在大會上,蔣杰展示了騰訊會議、騰訊文檔、騰訊廣告等多個業(yè)務,在接入騰訊混元大模型后的實際應用情況。

其中,騰訊會議基于混元大模型打造了AI小助手,只需要簡單的自然語言指令,就能完成會議信息提取、內容分析等復雜任務,會后還能生成智能總結紀要。據實測,在指令理解、會中問答、會議摘要、會議待辦項等多個方面,混元大模型均獲得較高的用戶采納率。

例如在廣告場景,騰訊混元大模型支持智能化的廣告素材創(chuàng)作,能夠適應行業(yè)與地域特色,滿足千人千面的需求,實現(xiàn)文字、圖片、視頻的自然融合。此外,基于混元大模型的能力,廣告智能導購能夠幫助商家在企業(yè)微信等場景,提升服務質量和服務效率。

在8月的財報電話會中,騰訊總裁劉熾平表示:“就生成式AI技術,或廣泛地對于基礎模型而言,我們認為此類技術和機會并不僅局限于聊天機器人這樣的問答式體驗。從更廣泛來看,我們對AI了解越多,就越對它作為我們業(yè)務的倍增器感到期待。AI技術將有助于提高用戶交互服務的效率和質量,促進我們的廣告定位、數(shù)據定位能力,以及提升許多內容生產的效率。因此,通過持續(xù)發(fā)展生成式AI,我們將能從多個方面受益。”

在騰訊看來,混元大模型的想象空間遠不止目前呈現(xiàn)給公眾的效果。像人類一樣,它能持續(xù)訓練、終身學習,訓練數(shù)據集會持續(xù)更新,不斷學習更新最新知識,以改善其性能和準確性。同時,混元大模型也將為騰訊在6月發(fā)布的模型即服務(MaaS)解決方案釋放更多市場潛力。

蔣杰介紹道,騰訊9月7日發(fā)布的通用大語言模型,也將作為騰訊云MaaS服務的底座,進一步服務更多的行業(yè)客戶。不僅如此,最近,騰訊云也全面接入Llama 2、Bloom等20多個主流模型,和混元一樣,都支持直接部署調用。客戶可以根據實際需求,基于混元、基于開源模型,打造自己專屬的行業(yè)大模型。

現(xiàn)在,混元大模型已經不是半成品了,但按照騰訊的高標準,還達不到“成品”的程度。“我認為混元永遠在路上,現(xiàn)在推出的版本只是可用,但我們一直在演進我們的能力,例如從大語言模型演進到文生圖。今天只是一個開始,我希望我們每個月都會給大家驚喜。”蔣杰最后說道。

編輯|蒙錦濤

如需轉載請與《每日經濟新聞》報社聯(lián)系。

未經《每日經濟新聞》報社授權,嚴禁轉載或鏡像,違者必究。

讀者熱線:4008890008

特別提醒:如果我們使用了您的圖片,請作者與本站聯(lián)系索取稿酬。如您不希望作品出現(xiàn)在本站,可聯(lián)系我們要求撤下您的作品。

歡迎關注每日經濟新聞APP