每日經濟新聞 2024-06-25 13:14:35

每經編輯 程鵬 黃勝

2024年6月20日,美國達特茅斯工程學院公布了對OpenAI首席技術官米拉·穆拉蒂(Mira Murati)的采訪視頻。米拉在采訪中透露,GPT-5將在一年半后發布,在某些領域將達到博士的智能。與此同時,Claude 3.5 Sonnet,已經成為了第一個測試分數高于最聰明的人類博士的模型。

圖片來源:截圖于Youtube

近日,OpenAI CTO米拉·穆拉蒂在達特茅斯工程學院發表了關于AI在各行業中的變革潛力及其對工作的影響的重要言論。

米拉表示,大約一年半年后,OpenAI將發布“博士生水平”的人工智能。相較之下,GPT-3相當于幼兒的智能水平,GPT-4更像高中生的智能水平。但她強調,博士等級的AI僅適用于某些特定任務,“這些系統在某些特定的任務中已經達到了人類水平,當然在許多其他任務中,它們還達不到。”

圖片來源:截圖于Youtube

與此同時,Anthropic于6月20日官宣發布了全新大模型 Claude 3.5 Sonnet,號稱是迄今為止最智能的模型。

圖片來源:X

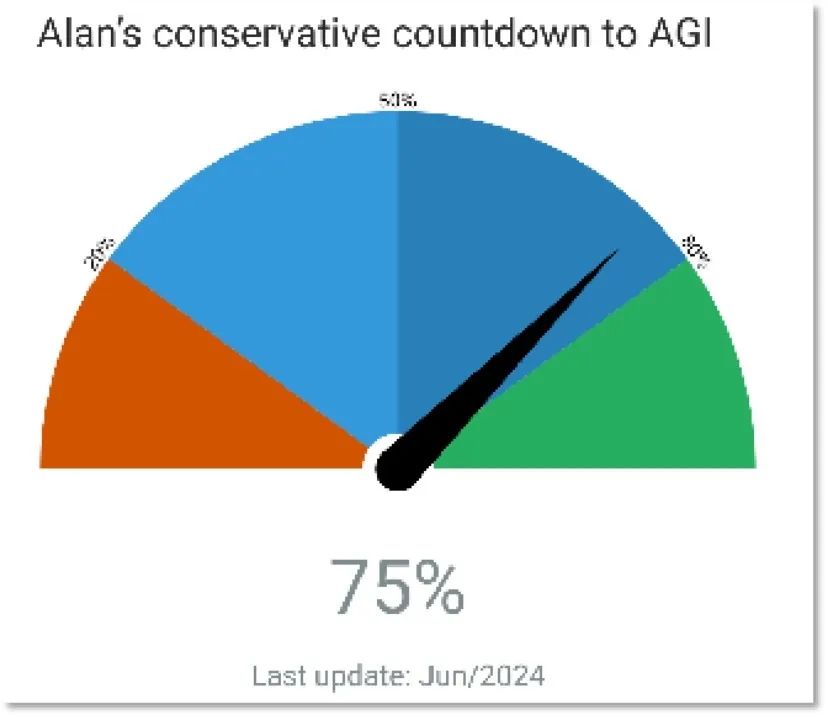

Claude 3.5 Sonnet不僅將AGI的倒計時推至75%,更是成為了第一個測試分數高于最聰明的人類博士分數的模型。

圖片來源:Life Architect

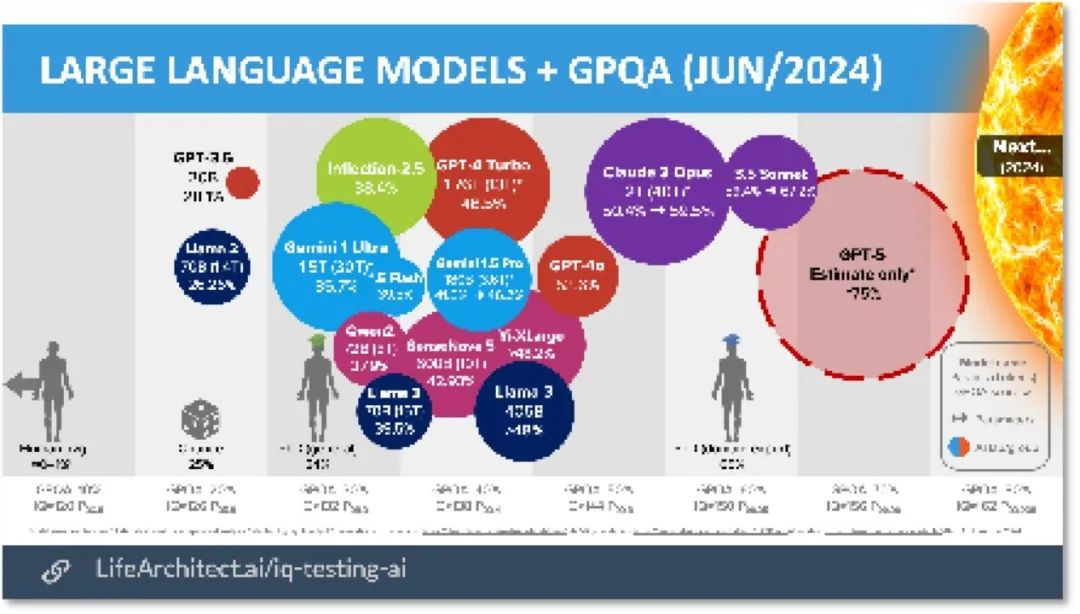

據Life Architect數據顯示,Claude 3.5 Sonnet在研究生級推理(GPQA)、本科級知識(MMLU)和編碼能力(HumanEval)上都刷新了SOTA。其中,在MMLU上,它得分90.4;在GPQA上,得分為67.2。這也是首次,LLM突破了GPQA 65%的分數,達到了最聰明的人類博士的水平。普通博士在GPQA上的得分為34%,領域內專業博士的得分為65%,而Claude 3.5 Sonnet,顯然已經超越了他們。

圖片來源:Life Architect

在達特茅斯學院的采訪中,主持人提出了一個假設性的問題,他問:“假設在三年后GPT變得極其智能,它是否可能自行連接到互聯網并開始行動?”

對此,米拉回答說:“確實,我們對此進行了很多思考。具備AI智能體能力的系統確實存在,它們會連接到互聯網,進行相互之間的交流,共同完成任務,或者與人類無縫合作。因此,我們在未來與AI的合作可能會像我們現在彼此之間的合作一樣。”

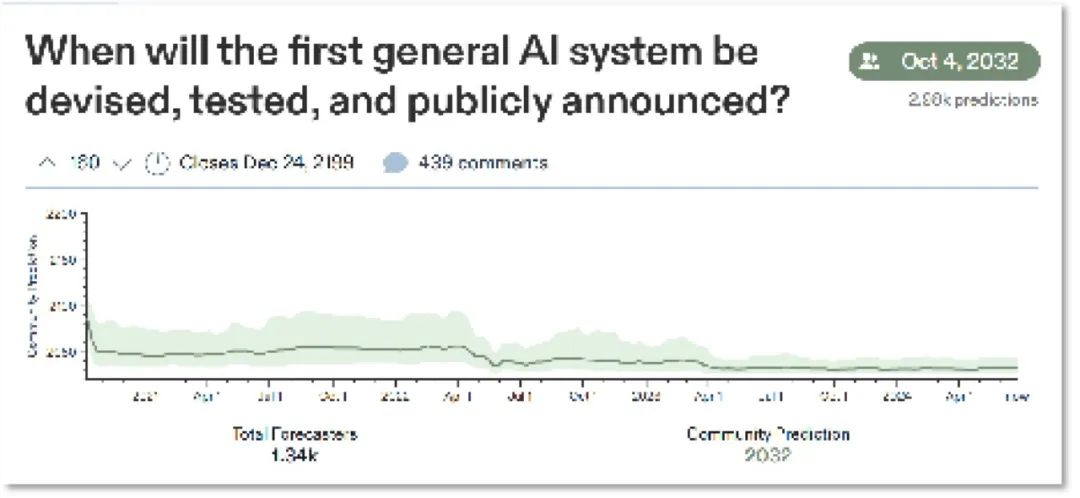

圖片來源:Metaculus

人工智能的進步速度令人驚嘆。

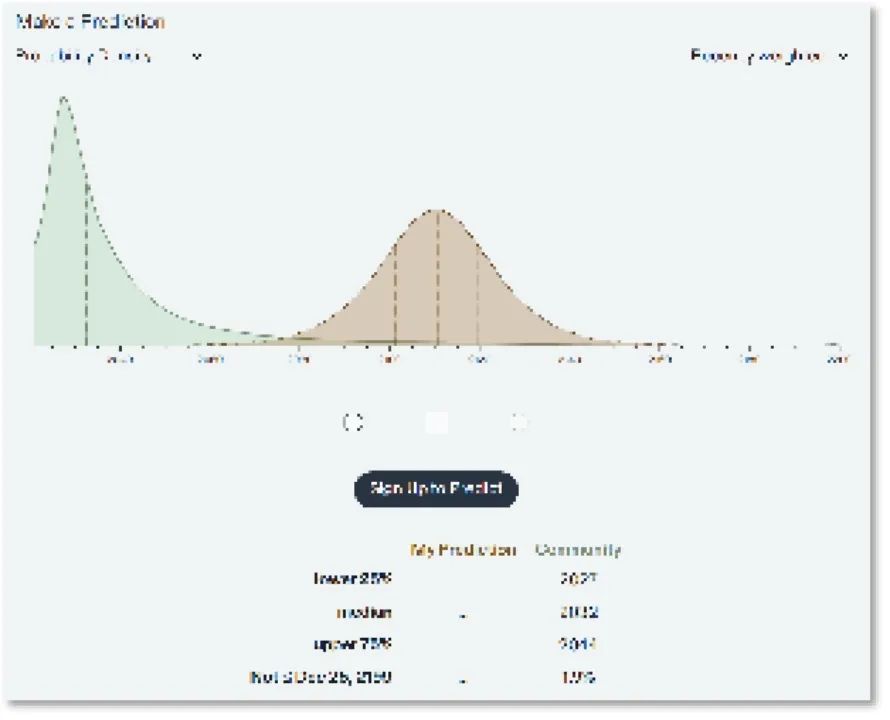

在2022年,專家們預測,人類水平的人工智能有可能在本世紀的60年代興起,可能性為50%。然而,Metaculus預測員社區的預測時間更早,他們預測的是40年代。隨著GPT-4的發布,社區的預測時間開始提前,預計在2032年,甚至最早在2027年,我們就有可能實現AGI。

圖片來源:Metaculus

6月20日凌晨,前 OpenAI 聯合創始人、首席科學家伊爾亞·蘇茨克(Ilya Sutskever)在社交媒體上官宣成立新公司 SSI,專注于安全超級智能。

網友稱:“好家伙!這是直接越過AGI,一步邁向Super Intelligence(超級智能)了。”

圖片來源:X

伊爾亞在SSI官方賬號中官宣的“開場詞”里表示:“超級智能已經觸手可及。構建安全超級智能(SSI)是我們這個時代最重要的技術問題。”

他還補充道:“我們將以一個焦點、一個目標、一個產品,直接追求安全的超級智能。我們將通過一個小而高效的團隊所創造的革命性突破來實現它。”

圖片來源:X

總而言之,伊爾亞團隊要搞的事情,用網友一個經典的表情包式的總結來看就是:

圖片來源:X

然而,人工超級智能的發展也引發了一些擔憂。

近日,一篇預印本論文提出觀點:隨著人工超級智能(ASI)的實現,人工智能無與倫比的能力可能會讓人們尊其為神,從而產生一種認知偏差,不加質疑地接受它的決定。

圖片來源:arxiv.org

作者特飛科·歐亞爾(Tevfik Uyar)警告說,這種現象可能導致我們混淆技術進步與道德倫理的優越性。“我們不能因為ASI的能力強大,就認為它在道德和倫理上也同樣表現優越。”

更令人擔憂的是,這種動態可能導致一種“技術官僚神權統治”,在這種統治下,決策權被移交給ASI,從而破壞了人類的主動性和批判性思維。作者強調:“如果我們將決策權交給ASI,那么人類的主動性和批判性思維可能會受到破壞。”

聲明:文章內容和數據僅供參考,不構成投資建議。投資者據此操作,風險自擔。

編輯|程鵬?黃勝?宋欣悅(實習)?杜恒峰

校對|段煉

每日經濟新聞綜合每日經濟新聞(記者:姚亞楠)、公開信息

如需轉載請與《每日經濟新聞》報社聯系。

未經《每日經濟新聞》報社授權,嚴禁轉載或鏡像,違者必究。

讀者熱線:4008890008

特別提醒:如果我們使用了您的圖片,請作者與本站聯系索取稿酬。如您不希望作品出現在本站,可聯系我們要求撤下您的作品。

歡迎關注每日經濟新聞APP