每日經(jīng)濟(jì)新聞 2024-07-24 06:28:32

每經(jīng)編輯 杜宇

當(dāng)?shù)貢r(shí)間周二,美國(guó)科技巨頭Meta發(fā)布了其最強(qiáng)開(kāi)源人工智能(AI)模型Llama 3.1,擁有三個(gè)不同的版本。扎克伯格稱其為“業(yè)內(nèi)頂尖水準(zhǔn)的”AI模型,并表示能夠與OpenAI和谷歌等競(jìng)爭(zhēng)對(duì)手的類似產(chǎn)品相抗衡。

Meta的公告顯示,Llama 3.1在Llama 3的基礎(chǔ)上進(jìn)行了重大更新,Llama 3.1主要用于驅(qū)動(dòng)聊天機(jī)器人,可以進(jìn)行八種語(yǔ)言的對(duì)話,編寫(xiě)更高質(zhì)量的計(jì)算機(jī)代碼,并可以解決更復(fù)雜的數(shù)學(xué)問(wèn)題。

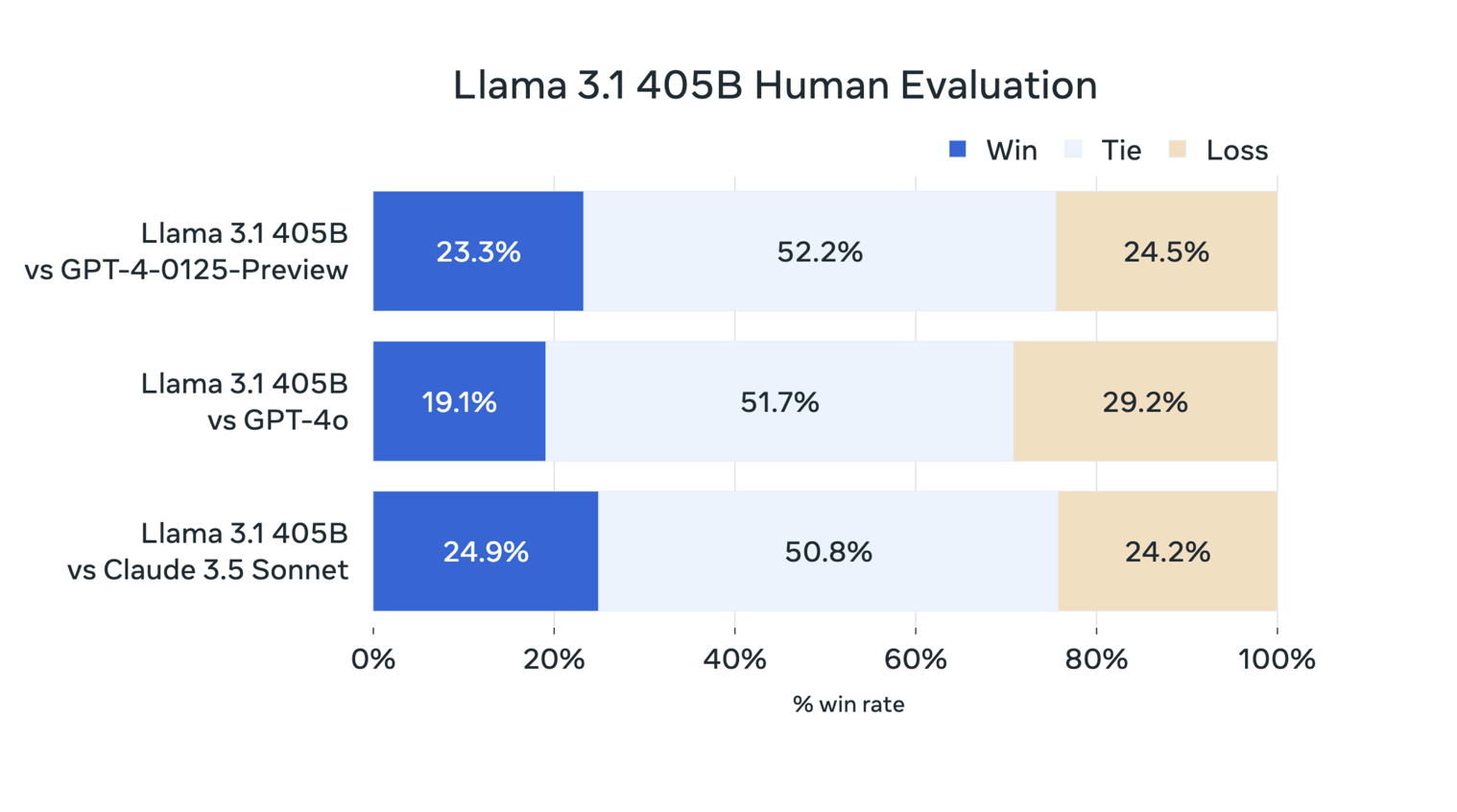

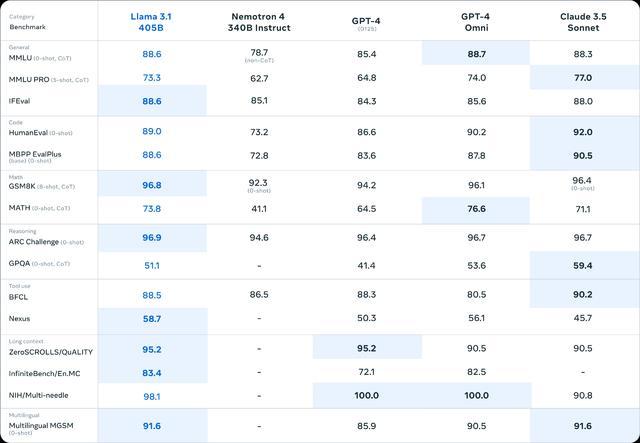

Llama 3.1 405B模型包含4050億個(gè)參數(shù),是近年來(lái)參數(shù)規(guī)模最大的模型之一。通常,參數(shù)大致對(duì)應(yīng)于模型的解決問(wèn)題的能力,參數(shù)越多的模型通常表現(xiàn)越好。該模型使用16000個(gè)英偉達(dá)H100 GPU進(jìn)行訓(xùn)練,受益于新的訓(xùn)練和開(kāi)發(fā)技術(shù),Meta聲稱,Llama 3.1 405B在一定程度上可以與OpenAI的GPT-4o和Anthropic的Claude 3.5 Sonnet競(jìng)爭(zhēng)。

Meta高管表示,該模型主要用于為Meta內(nèi)部和外部開(kāi)發(fā)人員的聊天機(jī)器人提供支持,具備廣泛的新功能,包括改進(jìn)的推理能力,幫助解決復(fù)雜的數(shù)學(xué)問(wèn)題或瞬間綜合整本書(shū)的文本。它還具有生成式AI功能,可以通過(guò)文本提示生成圖像。一項(xiàng)名為“想象自己”的功能允許用戶上傳他們的面部圖像,然后生成他們?cè)诓煌瑘?chǎng)景和情境中的描繪。

像其他開(kāi)源和閉源生成式AI模型一樣,Llama 3.1 405B可以執(zhí)行各種任務(wù),可以編程、回答基本數(shù)學(xué)問(wèn)題,也可以用八種語(yǔ)言(英語(yǔ)、德語(yǔ)、法語(yǔ)、意大利語(yǔ)、葡萄牙語(yǔ)、印地語(yǔ)、西班牙語(yǔ)和泰語(yǔ))總結(jié)文件。該模型目前僅支持文本操作,這意味著它不能回答圖像問(wèn)題,但大多數(shù)基于文本的工作負(fù)載(如分析PDF和電子表格)都在其能力范圍內(nèi)。

Meta表示,該公司正在嘗試多模態(tài)模型。在周二發(fā)表的一篇論文中,公司研究人員表示,他們正在積極開(kāi)發(fā)可以識(shí)別圖像和視頻并理解(和生成)語(yǔ)音的Llama模型。然而,這些模型尚未準(zhǔn)備好公開(kāi)發(fā)布。

與Meta之前的模型一樣,Llama 3.1 405B可以下載或在云平臺(tái)(如AWS、Azure和Google Cloud)上使用。它還在WhatsApp和Meta.ai上使用,為美國(guó)用戶提供聊天機(jī)器人體驗(yàn)。

另外,Llama 3.1的上下文窗口(context window)涵蓋128000個(gè)標(biāo)記,比以前的Llama模型更大,大約相當(dāng)于一本50頁(yè)書(shū)的長(zhǎng)度。

模型的上下文或上下文窗口指的是模型在生成輸出(如文本)之前考慮的輸入數(shù)據(jù)(如文本)。具有較大上下文窗口的模型,可以總結(jié)更長(zhǎng)的文本片段和文件。在為聊天機(jī)器人提供動(dòng)力時(shí),這種模型也不太可能忘記最近討論的主題。

Meta周二還推出了另外兩個(gè)新的較小模型Llama 3.1 8B和Llama 3.1 70B,這兩款模型是Meta在4月發(fā)布的Llama 3 8B和Llama 3 70B模型的更新版本,它們也有128,000個(gè)標(biāo)記的上下文窗口。相比之下,以前的模型上下文窗口最大為8,000個(gè)標(biāo)記。

Meta在論文中表示,Llama 3.1 405B的性能與OpenAI的GPT-4相當(dāng),在與GPT-4o和Claude 3.5 Sonnet的比較中取得了“混合結(jié)果”。盡管Llama 3.1 405B在執(zhí)行代碼和生成圖表方面優(yōu)于GPT-4o,但其多語(yǔ)言能力整體較弱,在編程和一般推理方面也落后于Claude 3.5 Sonnet。

在周二早上發(fā)布的一封公開(kāi)信中,Meta CEO馬克·扎克伯格描繪了一個(gè)未來(lái)的愿景,即AI工具和模型能夠到達(dá)世界各地更多的開(kāi)發(fā)者手中,確保人們能夠享受到AI的“好處和機(jī)會(huì)”。

扎克伯格既捍衛(wèi)自己的開(kāi)源策略,又大規(guī)模投資AI。“我認(rèn)為對(duì)于一個(gè)AI助手來(lái)說(shuō),最重要的產(chǎn)品特性將是它的智能程度,”扎克伯格在接受媒體采訪時(shí)說(shuō)道。“我們正在構(gòu)建的Llama模型是世界上最先進(jìn)的模型之一。”

扎克伯格補(bǔ)充說(shuō),Meta已經(jīng)在研發(fā)Llama 4。

扎克伯格還表示,Meta的聊天機(jī)器人擁有“數(shù)億”用戶,并預(yù)計(jì)到年底將成為世界上使用最廣泛的聊天機(jī)器人。他希望Meta以外的公司也能使用Llama來(lái)訓(xùn)練他們自己的AI模型。

Meta在AI上的投資非常大。扎克伯格表示,訓(xùn)練Meta的Llama 3模型花費(fèi)了“數(shù)億美元”的計(jì)算資源,但他預(yù)計(jì)未來(lái)的模型成本將更高。“未來(lái)這將需要數(shù)十億甚至更多的計(jì)算資源,”他說(shuō)。2023年,Meta試圖削減一些未來(lái)技術(shù)和管理層的支出,裁掉了數(shù)千個(gè)工作崗位,這是扎克伯格稱之為“效率之年”的一部分。但扎克伯格仍然愿意在AI競(jìng)賽中投入資金。

“我認(rèn)為現(xiàn)在很多公司都在過(guò)度建設(shè),你回頭看時(shí)可能會(huì)覺(jué)得‘哦,我們可能都花費(fèi)了更多的數(shù)十億美元’,”扎克伯格說(shuō)。“另一方面,我實(shí)際上認(rèn)為所有投資的公司都在做出理性的決定,因?yàn)槿绻浜罅耍磥?lái)10到15年你將在最重要的技術(shù)上處于劣勢(shì)。”

“如果AI在未來(lái)像移動(dòng)平臺(tái)一樣重要,那么我不想通過(guò)競(jìng)爭(zhēng)對(duì)手訪問(wèn)AI,”扎克伯格說(shuō),他長(zhǎng)期以來(lái)對(duì)Meta依賴于Google和蘋果手機(jī)和操作系統(tǒng)來(lái)分發(fā)其社交媒體應(yīng)用感到不滿。“我們是一家技術(shù)公司,我們需要不僅在應(yīng)用層面上構(gòu)建東西,還要在整個(gè)技術(shù)棧上進(jìn)行構(gòu)建。為此進(jìn)行這些巨大的投資是值得的。”

此外,Meta還聯(lián)合AI芯片領(lǐng)頭羊英偉達(dá)周二宣布,英偉達(dá)AI Foundry將為全球企業(yè)定制Llama 3.1生成式AI模型,將他們的數(shù)據(jù)與Llama 3.1 405B和英偉達(dá)Nemotron模型結(jié)合,創(chuàng)建“超級(jí)模型”。

今年4月份,Meta告訴投資者,它計(jì)劃今年的支出比最初的預(yù)期多出數(shù)十億美元,其中一個(gè)核心原因是對(duì)AI的投資。據(jù)該公司發(fā)文稱,到今年年底,預(yù)計(jì)將擁有約35萬(wàn)顆英偉達(dá)H100 GPU。

他還解釋了Meta的開(kāi)源政策的競(jìng)爭(zhēng)力,公眾可以免費(fèi)使用Llama背后的技術(shù),這將有助于使Meta的工作成為其他成功創(chuàng)業(yè)公司和產(chǎn)品的基礎(chǔ),從而使Meta在行業(yè)發(fā)展中擁有更大的影響力。

英特爾表示:“恭喜MetaAI!我們很激動(dòng)能用Llama 3.1的發(fā)布來(lái)優(yōu)化我們的AI產(chǎn)品組合。”

大部分網(wǎng)友對(duì)Meta表示祝賀,認(rèn)為L(zhǎng)lama 3.1是偉大的杰作,是開(kāi)源社區(qū)的勝利。

也有網(wǎng)友質(zhì)疑,規(guī)模如此巨大的模型,運(yùn)行的時(shí)候要耗費(fèi)多少電能?會(huì)對(duì)環(huán)境造成多大影響?

每日經(jīng)濟(jì)新聞綜合公開(kāi)資料

如需轉(zhuǎn)載請(qǐng)與《每日經(jīng)濟(jì)新聞》報(bào)社聯(lián)系。

未經(jīng)《每日經(jīng)濟(jì)新聞》報(bào)社授權(quán),嚴(yán)禁轉(zhuǎn)載或鏡像,違者必究。

讀者熱線:4008890008

特別提醒:如果我們使用了您的圖片,請(qǐng)作者與本站聯(lián)系索取稿酬。如您不希望作品出現(xiàn)在本站,可聯(lián)系我們要求撤下您的作品。

歡迎關(guān)注每日經(jīng)濟(jì)新聞APP