每日經濟新聞 2025-02-20 21:33:06

近期,每經記者調查發現,黑灰產正在兜售楊冪、迪麗熱巴等明星或政治人物、企業家的AI臉,僅賣1280元。該技術通過“綁架”手機攝像頭繞開平臺算法監測,并實現聲音與圖像實時同步克隆,在微信、抖音等多平臺“瞞天過海”。對此,有平臺方表示,嚴禁售賣AI換臉及類似商品,專家稱,目前難以實時攔截,需升級審核監管技術。

每經記者 杜蔚 孫宇婷 每經編輯 易啟江

黑灰產正在兜售楊冪、迪麗熱巴、劉亦菲等明星或者政治人物、企業家的AI臉,只需要1280元。《每日經濟新聞》記者(簡稱每經記者或記者)調查發現,AI臉在實時視頻通話和直播中都能“瞞天過海”,微信、抖音、快手、小紅書等平臺也難以識別。

記者暗訪了解到,與之前的網絡換臉完全不同,新技術實現了聲音與圖像的實時同步克隆,用戶只需模仿目標人物的發型和服裝,AI生成高仿真語音和面部表情,即可完成全套偽造。這種技術的成熟使得偽造視頻在視覺和聽覺上都達到了近乎完美的程度。新技術是通過“綁架”手機攝像頭,從而繞開了平臺算法監測。通過揮手、大幅遮擋來識別真偽的傳統手段,已完全失效。

面對如此逼真的實時AI變身,普通人如何自保?抖音、快手、微信等平臺作為億萬用戶的守護者,又該如何提升防御能力?站在新的十字路口,我們是否已準備好迎接這一挑戰?

1

拍臉按鼻露齒及大幅遮擋

都不會“掉臉”

在技術推動下,AI換臉已能實現實時視頻通話和直播不露餡,且成本低廉。

隨著人工智能技術的快速發展,AI深度偽造技術在過去幾年中經歷了顯著的迭代升級。在AI換臉技術方面,早期的換臉模型依賴于目標面部的清晰坐標(面部地標)進行操作。因此,普通人可以通過一些簡單的方法揭露偽造內容,例如要求視頻通話中的對方用手在臉上劃過。由于手部動作會遮擋面部地標,導致換臉模型無法準確識別和渲染,從而破壞換臉效果。然而,最新的AI換臉技術已經克服了這一缺陷。

記者暗訪了解到,最新的AI偽造技術實現了聲音與圖像的同步克隆。這種技術的成熟使得偽造內容在視覺和聽覺上都達到了近乎完美的程度,進一步增加了識別的難度。

打開“抖快小”等平臺搜索AI換臉、AI視頻通話等關鍵詞,發現不少IP主發帖,當中暗藏著以此牟利的黑灰產公司等信息。

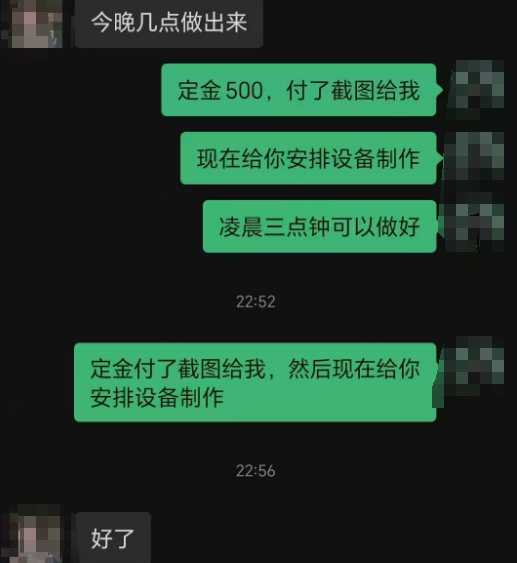

“照片由你提供,中外明星、名人或者企業家以及素人等,我們都能做。你怎么用,自己把握,我們不會去打聽,也不管。”《每日經濟新聞》記者以消費者身份暗訪時,一家AI換臉公司的工作人員徐盛(化名)表示,“定做一張(臉)1980元,先付500元訂金,5個小時左右做好。然后你就可以用這張臉在微信、QQ等平臺視頻通話,去抖音、快手等直播也是可以的。定做好的‘人臉’永久使用,多做幾張,我給你優惠,3張以上1600元,你可隨時切換‘臉’來用。”

為向記者展示“AI畫皮”術的高超,徐盛主動從微信等平臺給記者打來視頻電話,其間用力拍臉、按鼻、露齒以及大幅度的臉龐遮擋等,均未露餡。“你看,怎么都不會‘掉臉’。聲音也可以克隆,全套做好,你只要模仿對方的發型和服裝就行。”

據徐盛介紹,開年后前來“畫皮”的人很多,公司接單量較大,超負荷運行。“光我就接了近1000個,我們這里有七八臺設備,每天要做到凌晨五點。你想要名人臉,可以先發我名字,如果是我們公司庫中已有的(客人定制過的),可以優惠出售,這樣大家都方便。像楊冪、劉詩詩、迪麗熱巴、劉亦菲等,都是現成的,1280元一張(臉)。”

在談及公司的“定制臉”時,徐盛表示,目前以素人臉為主,“名人的話,在平臺上直播容易被舉報。”

2

“綁架”手機攝像頭

多平臺無法識別真偽

迭代后的“AI畫皮”技術,在實時視頻通話中,竟能避開多個平臺的監測。

暗訪中,徐盛轉場不同平臺向《每日經濟新聞》記者打來視頻電話,甚至“現身”直播間,都暢通無阻。在這些“實時流”中,相關畫面未有任何風險提示或被切斷。“我們還沒有收到有人被(平臺)發現的反饋,因為在手機攝像頭里,你打過去的時候,平臺上能看到的已經是‘換過的臉’。”

圖片來源:黑灰產從業者朋友圈

在進一步交流中,記者獲悉,使用“AI畫皮”時,需在手機和電腦端都安裝由上述公司提供的軟件。“我們不僅支持在微信、QQ、抖音、快手、小紅書上進行視頻通話或直播,一些海外平臺,如WhatsApp、Telegram、Line也可以。”徐盛告訴記者。

為什么“AI畫皮”能在這么多平臺“瞞天過海”?“它是通過‘綁架’我們的手機攝像頭來實現的‘變臉’,而非篡改平臺算法。”國內一家科技公司的相關負責人告訴每經記者。

對此,中國人民大學民商事法律科學研究中心副主任姚歡慶在接受每經記者采訪中提醒,當這種技術主要用于“綁架攝像頭”的效果時,非常有可能構成“提供侵入計算機信息系統程序罪”。在構罪的情況下,軟件的技術開發者、用戶都很難脫罪。

“平臺對AI生成的深度偽造(包括AI換臉和克隆語音等)難以實時檢測,因為平臺并非為鑒證級別的(面部或音頻)分析而設計。以克隆語音為例,加密使得掃描變得不可能,而壓縮則扭曲了語音信號,讓檢測更加復雜,此外,計算負擔也很高。”全球知名科技公司Sensity AI聯合創始人弗朗切斯科·卡瓦利向《每日經濟新聞》記者表示。Sensity AI專注于網絡安全和人工智能領域,特別是通過AI技術檢測和預防深度偽造(Deepfake)等威脅。

2024年度《人工智能指數報告》(AI Index Report 2024)指出,2023年報告了123起人工智能濫用事件,比2022年增加了32.3%。自2013年以來,這類事件增加了二十多倍。知名的例子包括由AI生成的美國明星泰勒•斯威夫特,這一具有性暗示的深度偽造視頻在網上廣泛傳播,反映出AI在隱私、安全等方面的風險。該報告由“人工智能教母”李飛飛聯合領導的斯坦福以人為本人工智能研究所(Stanford HAI)發布。

世界經濟論壇官網今年1月發布的報道指出,生成式人工智能(GenAI)的興起使欺詐行為以前所未有的速度增長。2023年,利用深度偽造技術繞過身份驗證的事件激增704%。

“AI深度偽造已成為網絡犯罪分子的一個新興操作工具。”卡瓦利直言。

姚歡慶向每經記者指出,“但凡采用AI技術模仿明星或者名人的聲音或者肖像,用于通話和直播帶貨,使得他人產生誤認的效果,涉嫌違法,并至少構成一種不正當競爭行為,從而要承擔停止侵權、賠償損失的法律責任。至于是否構成對他人肖像權、聲音權的侵犯,還需要根據具體情節確定。”

3

平臺回應:

嚴禁售賣 AI換臉

及與之類似的商品

當“AI畫皮”頻繁出沒,擁有數億月活用戶的平臺們,也感受到這次危機的嚴峻。

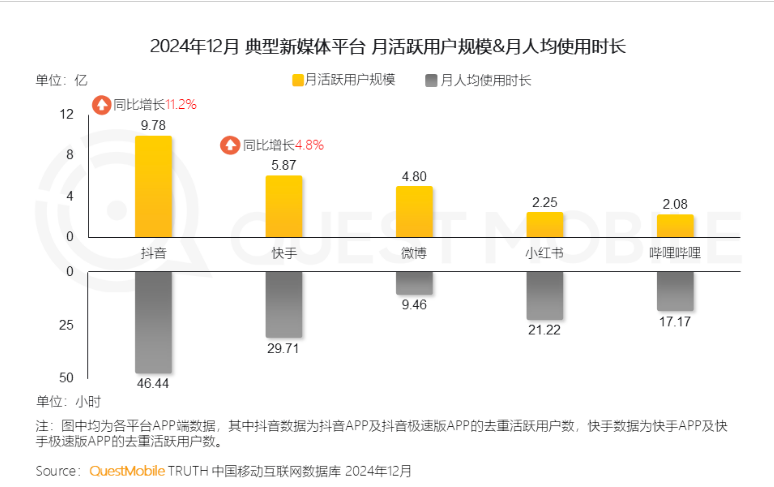

數據顯示,截至2024年三季度,微信月活躍賬戶數達13.82億。2月18日,專注移動互聯網數據分析的第三方機構QuestMobile發布最新數據,2024年12月全網月活躍用戶規模再次刷新歷史紀錄,達到12.57億。其中,抖音、快手、小紅書的月活躍用戶規模分別為9.78億、5.87億、2.25億。

北京市隆安律師事務所上海分所律師賈玉倩向《每日經濟新聞》記者表示,平臺有義務根據自查、用戶投訴等反饋信息,及時下架有欺詐風險的視頻。

對此,姚歡慶表示,“提供換臉服務的平臺,很有可能要承擔責任。因為換臉服務雖然也可以用于正當目的,但更大的概率是用于不正當的活動。當然,這部分需要立法上明確。即換臉服務應當是一種特許經營,類似于開鎖,需要獲得政府的準入。如果是這樣,平臺就有審核義務。”

針對技術升級后的“AI畫皮”情況,抖音方面相關負責人向《每日經濟新聞》記者表示,“我們平臺不鼓勵對‘AI換臉’等可能涉及侵犯他人權益的內容進行宣傳、推廣或教授。對于宣傳推廣AI換臉軟件或教學等內容,以及未經他人授權或同意,利用他人形象創作可能誤導觀眾為該人物本人發布或真實發生的視頻內容,均會予以相應管控。”

在直播場景下,抖音也全面禁止不當使用AI換臉技術,因為會造成用戶的混淆認知。并禁止以獵奇、夸大噱頭等對AI技術不當宣傳行為。上述負責人表示:“根據不同嚴重程度,我們會對相關賬號進行從警告中斷到封禁直播權限不等的處置。”

“我們持續治理‘AI換臉’相關內容,針對‘AI換臉冒充他人’‘違規提供AI換臉服務’等內容,平臺會根據規則進行相應管控。”小紅書方面相關負責人向記者表示。

微信視頻創作安全中心相關負責人亦告訴《每日經濟新聞》記者,對于涉及真人出鏡的內容,無論是否使用 AI 技術制作,若存在冒充他人的傾向或用于商業用途,均需提供證明材料,確保為本人真實身份或已獲得相應授權。“完全由 AI 生成的人臉內容,需提交AI制作過程的相關信息,并使用平臺提供的功能進行顯著標識。”

同時,微信、“抖快小”等方面的相關人士均向每經記者表示,若用戶發現平臺上出現“AI換臉”相關的違規內容,都可通過站內官方渠道進行舉報。

“為切實保障用戶權益,維護平臺健康生態,我們明確規定:嚴禁售賣 AI 換臉及與之類似的商品。”抖音電商相關負責人在接受記者采訪時表示,像利用AI 技術進行換臉、換聲,以致干擾、誤導用戶判斷的這類商品和信息,均被平臺列入違禁范疇。一旦發現商家存在違規操作,平臺將秉持從嚴原則,依據相關規定予以處理;若情節嚴重,不僅會封禁相關商品,還會責令店鋪停業整頓。

4

目前無法實時攔截

審核及監管需升級技術

盡管平臺們十分重視“AI畫皮”帶來的隱患,但采訪中,多家平臺和技術專家均向《每日經濟新聞》記者坦言,目前對在視頻通話和直播中的“畫皮人”實施攔截的難度極高。

“我們有技術層面的主動識別,但無法窮盡,也有通過舉報反向治理。”有平臺方面稱。

針對平臺的審核挑戰,卡瓦利向《每日經濟新聞》記者表示,加密平臺無法直接分析內容,并且,于平臺而言,想要在數百萬個同時發生的視頻通話(直播)中,運行深度學習模型具有很大的挑戰性,成本也較高。要阻擋實時AI深度偽造的攻擊,最大的技術挑戰在于“隱私悖論以及(平臺)與攻擊者間的貓鼠游戲”。

“平臺無法在不違反隱私法律的情況下掃描加密通話,而攻擊者則不斷改進AI生成的畫面、聲音以逃避檢測。除非模型直接嵌入用戶設備,否則實時攔截不太可能有效。”卡瓦利坦言。

在看過《每日經濟新聞》記者提供的“AI畫皮人”后,有行業人士提出了擔憂,“AI換臉人”是否能繞過系統的“真人驗證”。未來是否會發生偽裝成去世老人“吃空餉”,而一些空殼公司則可能借用AI換臉注冊后逃避債務。

“(技術上講)這是可行的,當前的深度偽造技術可以欺騙面部和語音識別的防偽驗證。”卡瓦利向每經記者解釋道,大多數系統只是檢查出現的臉部和聲音是否匹配,而不會檢查它們是否來自真人。

圖片來源:黑灰產從業者聊天記錄截圖

卡瓦利預測,“AI深度偽造技術會變得更成熟。模型將繼續縮小規模,使實時、超逼真的深度偽造通話對任何擁有智能手機的人都可以訪問。我們還將看到多模態深度偽造——語音、視頻,甚至行為生物特征被合成在一起,創造出完全虛假的身份。防御措施必須同樣快速跟上。”

AI技術在推動社會生產力發展的同時,也正以驚人速度淪為新型犯罪手段。姚歡慶在接受每經記者采訪時指出:“整體技術的開發和應用,都應當通過立法來嚴格限制。目前的環境總體來說過于寬松。”

姚歡慶認為,“AI詐騙數量的大幅增長跟技術的發展是密不可分的。作為詐騙者和整個社會,其實就是一個道魔斗法的過程,這當中,網絡詐騙導致技術追蹤的難度,以及詐騙者利用不同法域詐騙導致的管轄尤其值得重視。并且,鑒于人工智能技術的濫用具有跨境性質,需要國際合作機制解決,否則很難很好地保護權利人的利益。”

“AI行業可結合司法規范,統一建立便于監管識別的AI內容標識,便于追根溯源。同時,要考慮到AI技術不斷迭代、傳統審核手段應對的局限性,審核及監管部門需要升級技術,關注技術防御的迫切性。”賈玉倩建議,應從源頭肅清技術濫用風險,同時,平臺方應加強傳播的信息審核,強化通過AI合成的提示標識,并對用戶做好此類技術存在侵權風險的教育工作。

策劃|宋德萍

記者|杜蔚 孫宇婷

編輯|易啟江

視覺|蔡沛君

排版|易啟江

如需轉載請與《每日經濟新聞》報社聯系。

未經《每日經濟新聞》報社授權,嚴禁轉載或鏡像,違者必究。

讀者熱線:4008890008

特別提醒:如果我們使用了您的圖片,請作者與本站聯系索取稿酬。如您不希望作品出現在本站,可聯系我們要求撤下您的作品。

歡迎關注每日經濟新聞APP